Recientemente he disfrutado de un documental increíblemente bueno, sobre la inteligencia artificial y los sesgos con los que actualmente se enfrenta… pero, como siempre desde un pensamiento éticos me cuestiono: ¿Qué estamos haciendo para corregirlos?

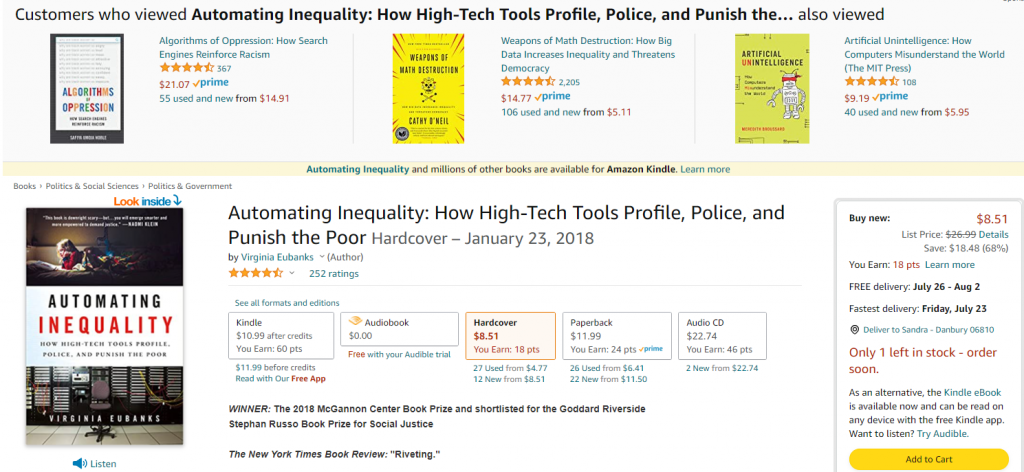

Me dejo muchas ideas y tareas pendientes, desde leer el libro “Weapons of math destrution” en español “Armas de destrucción matemáticas” de la Dra. Cathy O´Neil, hasta seguir trabajando con el podcast #TéDigital a como lo hemos tratado de hacer, despacio y con buena letra. Sumado a este primer libro por otro lado también debo de pensar en el de Automating Inequality de la Dra. Virginia Eubanks.

Tareas pendientes: el tema de brechas de genero también se aborda en el documental, la neutralidad de las maquinas ¿Existe?.

Nombre del documental: #CodedBias (es el de la imagen), lo puede encontrar en telegram.

“algorithm = using historical information to make a prediction”

Los algoritmos = son como el uso de información histórica para hacer predicciones sobre el futuro –

“Machine learning = a scoring system that scores the probability = at what you´re about to do”

El aprendizaje automático de máquinas o machine learning es un sistema de puntuación que califica la probabilidad de lo que estás por hacer. –

Con los algoritmos puede llegar a ver una distribución de poder asimétrica, tal cual la que existe hoy en día, pero con brechas más grandes “quienes son los que tiene el código fuente” respondernos a esa frase entre comillas nos lleva a pensar como lo han dicho muchos autores que las grandes empresa tecnológicas están logrando de alguna forma controlar el mundo.

El documental como muchos otros nos invita a buscar éticamente regular las tecnologías que van saliendo con velocidades impensables, sumado al hecho que cada una de estas nuevas tecnologías carecen de marcos regulatorios o como lo llamamos en la carrera: “carecen de frameworks.

¿Riegos con los avances de la IA?

Muchos, dentro del producto de multimedia podemos encontrar muchos muy claro, desde el tema que se esta procesando ya información que probablemente se recopilo de forma errónea, e incluso con las limitantes de los usuarios, hasta el hecho que incluso el aprendizaje automático hoy en día puede llegar a ser una caja negra que ni nosotros como programadores podemos llegar a entender.

¿Estamos claros que existe la vigilancia corporativa?

Facebook, Apple (recordemos que actualmente ellos nos hacen creer que nos ayudan con el tema de la privacidad), Amazon, IBM, Google, Microsoft.

Por otro lado, también tenemos a Alibaba Group, Tencent y Baidu.

Tenemos como responsabilidad preguntarnos que tanta información tienen estas empresas de nosotros, al menos las primeras seis que están en nuestro hemisferio lo cual nos llevaría a pensar que tanto pueden llegar a hacer si cada una de ellas implemente una inteligencia artificial a su servicio.

La pregunta inicial a la altura de esta línea se responde de forma fácil, es importante ver este tipo de productos con el fin de seguir creando conciencia del gran poder que tenemos en nuestras manos que de igual forma como lo dijo el tío Ben: genera una gran responsabilidad.

Un comentario en «Coded Bias – ¿Qué esperan para verla?»